- วิดีโอบิดเบือนข้อเท็จจริง (Disinformation) ที่สร้างโดย AI และมีเนื้อหาเกี่ยวข้องกับการสร้างความเกลียดชังในบริบทความขัดแย้งชายแดนไทยและกัมพูชาที่ใช้ในงานศึกษาชิ้นนี้ เป็นวิดีโอเนื้อหาภาษาไทย สื่อสารกับผู้รับสารคนไทยโดยเฉพาะ

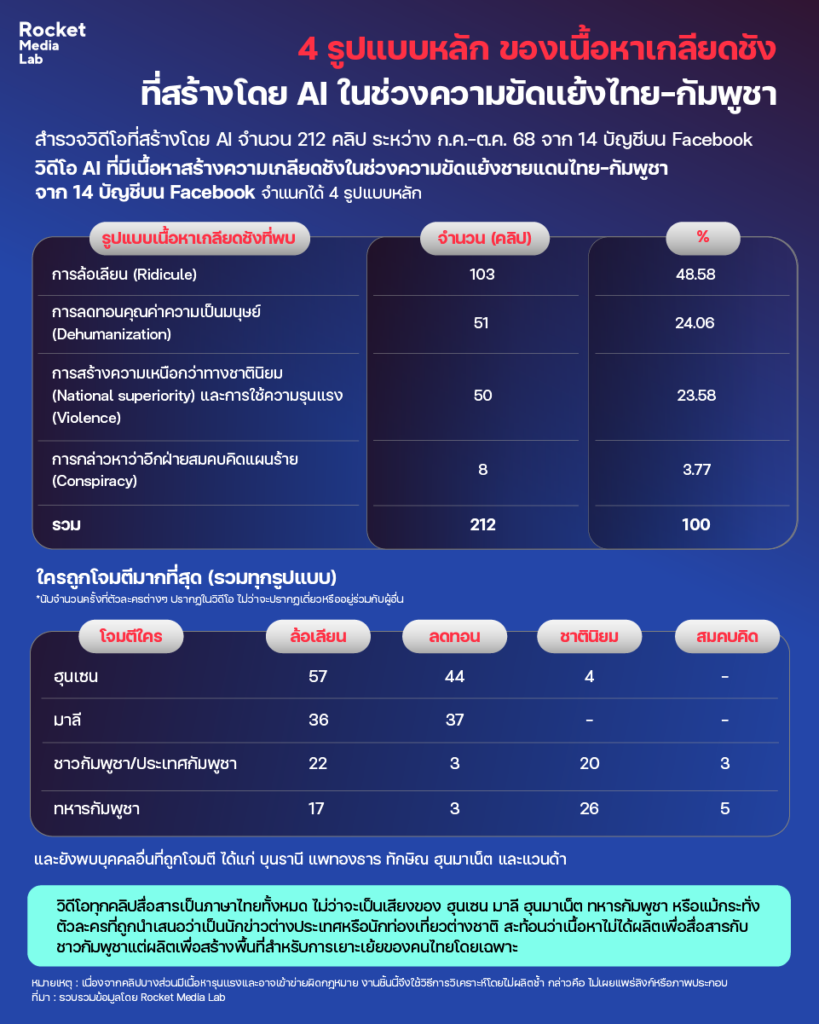

- ลักษณะการเล่าเรื่องประกอบด้วย 4 รูปแบบหลัก คือ 1. การล้อเลียน 2. การลดทอนคุณค่าความเป็นมนุษย์ 3. การสร้างความเหนือกว่าทางชาตินิยม และ 4.การกล่าวหาว่าอีกฝ่ายสมคบคิดแผนร้าย

- คลิปที่สร้างโดย AI เหล่านี้ ไม่ได้มุ่งหมายสื่อสารเนื้อหาการเมืองหรือเรื่องความสัมพันธ์ระหว่างประเทศ เท่ากับการสร้างคลิปบันเทิงที่จุดติดได้ด้วยปลุกปั่นความเกลียดชัง

ในเดือนกรกฎาคม ปี 2568 ความขัดแย้งทางทหารระหว่างไทยและกัมพูชาปะทุขึ้นอีกครั้งตามแนวชายแดน นับเป็นวิกฤตที่มีรากฐานทั้งจากข้อพิพาทเรื่องพื้นที่ทับซ้อนที่ยาวนานนับทศวรรษ และจากความตึงเครียดทางการเมืองที่สะสมระหว่างสองประเทศ ความขัดแย้งในครั้งนี้ ไม่ได้จำกัดอยู่เพียงพื้นที่ชายแดน แต่ยังขยายตัวเข้าสู่พื้นที่ออนไลน์อย่างรวดเร็ว ซึ่งเป็นพื้นที่ที่เนื้อหาปลุกปั่นสร้างความเกลียดชังแพร่กระจายได้โดยไม่มีข้อจำกัดด้านพื้นที่และเวลา

ในวิกฤตครั้งนี้ สมรภูมิทางความคิดที่รุนแรงบนพื้นที่ออนไลน์มีเทคโนโลยีปัญญาประดิษฐ์ (AI) เป็นตัวช่วยผลิตสื่อสังเคราะห์ (Synthetic Media) ทั้งภาพและเสียงที่สมจริงสูงจนยากต่อการคัดกรอง ในระหว่างที่ความขัดแย้งดำเนินไป บัญชีผู้ใช้หลายรายบน Facebook ใช้โอกาสนี้ผลิตวิดีโอ AI เพื่อขยายกระแสความเกลียดชัง ควบคู่ไปกับการเปิดรับรายได้จากผู้ติดตาม สะท้อนให้เห็นว่าความเกลียดชังไม่เพียงแพร่กระจายได้ง่าย แต่ยังกลายเป็น ‘สินค้า’ ที่สร้างรายได้อีกด้วย

Rocket Media Lab รวบรวมวิดีโอที่เข้าข่ายการบิดเบือนข้อเท็จจริง (Disinformation) ที่สร้างโดย AI และมีเนื้อหาเกี่ยวข้องกับการสร้างความเกลียดชังในบริบทความขัดแย้งชายแดนไทยและกัมพูชา จำนวน 212 คลิป จาก 14 บัญชีผู้ใช้บน Facebook โดยในจำนวนนี้มี 9 บัญชีที่เปิดหารายได้โดยให้สมัครสมาชิกรายเดือนได้ มีราคาเริ่มต้นตั้งแต่ 19 บาทไปจนถึง 69 บาทต่อเดือน การเก็บข้อมูลครอบคลุมตั้งแต่ช่วงเริ่มเหตุปะทะในเดือนกรกฎาคม จนถึงการลงนามหยุดยิงในเดือนตุลาคม 2568 เพื่อวิเคราะห์ลักษณะของวิดีโอที่สร้างโดย AI ทั้งในแง่รูปแบบการสื่อสาร วิธีการสร้างความเกลียดชัง กลุ่มเป้าหมายที่ถูกโจมตี ตลอดจนบทบาทของเนื้อหาเหล่านี้ในการขยายความขัดแย้งในพื้นที่ออนไลน์

วิธีการเก็บข้อมูล

การเก็บข้อมูลเริ่มต้นจากการค้นหาบน Facebook ด้วยคีย์เวิร์ด (Keyword) ที่เกี่ยวกับความขัดแย้งโดยตรง ทั้งชื่อบุคคล เช่น ฮุนเซน มาลี และคำที่สะท้อนบริบทความตึงเครียด เช่น ทหารกัมพูชา สงคราม และชายแดน จากนั้นกรองเฉพาะวิดีโอที่สร้างด้วย AI และมีเนื้อหาที่เข้าข่ายสร้างความเกลียดชัง การเก็บข้อมูลเน้นไปที่ 14 บัญชีผู้สร้างที่มีความสม่ำเสมอในการผลิตเนื้อหาลักษณะนี้ตลอดช่วงเวลาดังกล่าว และไม่ได้รวบรวมวิดีโอทั้งหมดที่มีอยู่ แต่คัดเลือกตัวอย่างที่สะท้อนรูปแบบเนื้อหาเกลียดชังได้อย่างชัดเจน ข้อมูลที่รวบรวมได้นำมาวิเคราะห์และจำแนกลักษณะการเล่าเรื่อง (Narrative) ออกเป็น 4 หมวดหลัก โดยพิจารณาจากทั้งคีย์เวิร์ดในบทพูด องค์ประกอบภาพและเสียงที่ปรากฏในวิดีโอ

4 รูปแบบหลัก ของเนื้อหาเกลียดชังที่สร้างด้วย AI

จากการวิเคราะห์วิดีโอทั้ง 212 คลิปที่ถูกสร้างขึ้นด้วย AI สามารถจำแนกรูปแบบการสร้างเนื้อหาเกลียดชังที่พบออกได้เป็น 4 รูปแบบหลัก ตามลักษณะการเล่าเรื่อง (Narrative) ได้แก่

1. การล้อเลียน (Ridicule) คือรูปแบบที่พบมากที่สุด โดยปรากฏเป็นแกนหลักของเรื่องในวิดีโอรวม 103 วิดีโอ ในจำนวนนี้เป็นการล้อเลียนอย่างเดียว 81 คลิป และอยู่คู่กับรูปแบบอื่น เช่น ลดทอนคุณค่าความเป็นมนุษย์ ใช้ความรุนแรง (Violence) และใช้มุกตลกทางเพศ (Sexual joke) เป็นรูปแบบย่อยคู่กับการล้อเลียนไปด้วย อีก 22 คลิป เนื้อหาประเภทนี้ใช้การล้อเลียนผ่านภาพและเสียงที่สร้างด้วย AI เพื่อทำให้ผู้นำและบุคคลสาธารณะของกัมพูชาดูตลก ไร้ความสามารถ หรืออยู่ในสถานการณ์ที่น่าอับอาย

2. การลดทอนคุณค่าความเป็นมนุษย์ (Dehumanization) เป็นรูปแบบที่พบรองลงมา พบ 51 วิดีโอ โดยมีเนื้อหาที่มุ่งเป้าเพื่อลดทอนความเป็นมนุษย์อย่างเดียวจำนวน 48 คลิป และมีอีก 3 คลิปที่ผสมกับการล้อเลียน เนื้อหาลักษณะนี้มักนำใบหน้าบุคคลจริงไปซ้อนทับกับสัตว์หรือสิ่งที่ถูกมองว่าต่ำต้อย เช่น หมาขี้เรื้อน ตัวเงินตัวทอง งู หรือแมลง โดยรูปแบบนี้จะแตกต่างจากการล้อเลียนทั่วไปคือ การล้อเลียนจะยังคงสถานะความเป็นมนุษย์ของผู้ถูกโจมตี แต่ทำให้หัวเราะกับพฤติกรรมที่ดูตลกหรือน่าอับอาย ขณะที่การลดทอนความเป็นมนุษย์จะตัดขาดความเป็นมนุษย์โดยสิ้นเชิง ทำให้ผู้ชมรับรู้ผู้ถูกโจมตีในฐานะสัตว์แทน

3. การสร้างความเหนือกว่าทางชาตินิยม (National superiority) และการใช้ความรุนแรง (Violence) พบใน 50 คลิป โดยทั้งสองรูปแบบมีลักษณะร่วมกันคือการสร้างภาพความเหนือกว่าทางทหารของฝ่ายไทย ผ่านวิดีโอที่นำเสนอภาพอาวุธยุทโธปกรณ์ การโจมตี หรือการพ่ายแพ้ของอีกฝ่าย เพื่อเล่าเรื่องว่ากัมพูชาเป็นฝ่ายพ่ายแพ้และสูญเสีย

4. การกล่าวหาว่าอีกฝ่ายสมคบคิดแผนร้าย (Conspiracy) พบในจำนวนน้อยที่สุดรวม 8 รายการ เนื้อหาประเภทนี้จะสร้างภาพภัยคุกคาม โดยกล่าวหาว่าฝ่ายกัมพูชากำลังดำเนินการบางอย่างอย่างลับๆ ซึ่งมีแนวโน้มที่จะกระตุ้นความกลัวและความระแวงให้แก่คนดู

วิเคราะห์วิดีโอล้อเลียน : เมื่อการล้อเลียนกลายเป็นเกราะกำบัง

จากการเก็บข้อมูลคลิปที่ generate ด้วย AI (เจน AI) ที่มีเนื้อหาสร้างความเกลียดชังในช่วงความขัดแย้งไทย-กัมพูชา ทั้งหมด 212 คลิป พบรูปแบบการล้อเลียน (Ridicule) เป็นสัดส่วนสูงถึง 48.58% (103 คลิป) ของเนื้อหาทั้งหมด โดยมีจุดเด่นที่วิธีเล่าเรื่องให้ดู ‘ตลก’ เพื่อเป็นเกราะกำบังในการส่งผ่านวาทกรรมเกลียดชังและการทำลายความน่าเชื่อถือของอีกฝ่ายอย่างรุนแรง

วิดีโอที่มียอดเข้าชมและยอด engagement สูงสุดในหมวดล้อเลียน

- วิดีโอที่มียอดเข้าชมสูงสุด คือวิดีโอเจน AI ให้ฮุนเซนเกาะกระจกเครื่องบินรบ พร้อมพูดอ้อนวอนว่า “กูขอร้องกี่ครั้งแล้วว่าอย่าใช้ F-16 กูไหว้ล่ะ” มียอดเข้าชมสูงถึง 5,600,000 ครั้ง ยอด engagement รวม 57,000 ครั้ง ยอดแชร์ 3,100 ครั้ง และแสดงความคิดเห็น 1,800 ครั้ง เผยแพร่ ณ วันที่ 10 สิงหาคม 2568

- วิดีโอที่มียอด engagement สูงสุด คือวิดีโอเจน AI เป็นทหารกัมพูชาคุยกันว่า “เสบียงไม่มีจะขัดกระทะทำไม” อีกคนตอบ “วิทยุบอกเดี๋ยวมีไข่มาส่ง” และตัดภาพไปเป็นเครื่องบินรบจากไทยบรรทุกระเบิดมาพูดว่า “ไข่ฟองโตมาส่งแล้วครับ” มียอดเข้าชม 1,800,000 ครั้ง และมียอด engagement สูงถึง 88,000 ครั้ง ยอดแชร์ 1,700 ครั้ง แสดงความคิดเห็น 595 ครั้ง เผยแพร่ ณ วันที่ 3 สิงหาคม 2568

เนื้อหาที่ได้รับความนิยมเหล่านี้ไม่ได้เน้นที่การแสดงข้อเท็จจริงใดๆ แต่เน้นสร้างความสะใจ และเปลี่ยนความตึงเครียดของสถานการณ์ชายแดนให้กลายเป็นสินค้าความบันเทิง นอกจากนี้ เมื่อวิเคราะห์เนื้อหาของวิดีโออื่นๆ ในหมวดนี้ยังพบองค์ประกอบที่ซ้ำกัน ได้แก่

1. ทำลายภาพลักษณ์ผู้นำ มีการใช้ AI เปลี่ยนภาพลักษณ์ของผู้นำกัมพูชาให้ตกอยู่ในสถานการณ์ที่น่าอับอาย โดยเฉพาะการให้แต่งกายด้วยชุดผู้หญิง ใส่ชุดเสื้อเกาะอก กระโปรง รองเท้าส้นสูง หรือชุดรัดรูป ตัวอย่างเช่น วิดีโอเจน AI ให้ฮุนเซนและฮุนมาเน็ตใส่ชุดเกาะอกและกระโปรง วิ่งหนีร้องไห้กอดคอกัน พร้อมพูดว่า “ยอมแล้ว ไม่เอาแล้ว” โดยมีฉากหลังเป็นเครื่องบินรบและรถถัง ในหลายวิดีโอยังให้แสดงกิริยาที่ถูกมองว่าไม่เหมาะสมกับภาพลักษณ์ผู้นำ ไม่ว่าจะเป็นการเต้นแอโรบิก หรือนั่งบนรถถังขึ้นสนิม

2. ล้อเลียนว่าเป็นประเทศที่ยากจนหรือใช้เทคโนโลยีที่ล้าสมัย วิดีโออีกจำนวนมากเจน AI เป็นภาพกองทัพที่ไร้ประสิทธิภาพ เครื่องบินขึ้นสนิมสตาร์ตไม่ติด งบประมาณไม่พอซื้ออาวุธจริง และทหารอายุมากที่อ่อนแอ วิดีโอเหล่านี้พยายามสร้างภาพว่ากัมพูชาไม่ใช่ภัยคุกคามที่ต้องกังวล เพื่อตอกย้ำความเหนือกว่าของไทย เช่น วิดีโอเจน AI เป็นฮุนเซนเปิดเผยอาวุธลับ ซึ่งเป็นปืนฉีดน้ำที่อ้างว่าสั่งมาจากลาซาด้าในช่วงลดราคา

3. การลดทอนสถานะให้เป็นขอทาน หรือผู้รอรับความช่วยเหลือ วิดีโอส่วนหนึ่งใช้การสร้างบทสนทนาให้ชาวกัมพูชาหรือทหารยอมรับว่าตนเองต้องพึ่งพาไทยหรือเป็นขอทาน เช่น วิดีโอเจน AI เป็นการสัมภาษณ์ชาวกัมพูชาที่ใส่เสื้อผ้าขาด ตอบคำถามนักข่าวว่าที่ชอบฉีกแบงก์ 20 ของไทย เพราะ “เราเป็นขอทาน คนไทยโยนเศษเงินมาให้มากสุดก็แค่แบงก์ 20” หรืออีกวิดีโอเจน AI เป็นชาวกัมพูชายืนหลังรั้วลวดหนามและพูดว่า “เราต้องรื้อลวดหนามเพื่อเข้าไปเป็นขอทานในไทยให้ได้”

4. การใช้มุกตลกทางเพศและความสัมพันธ์ที่ผิดศีลธรรม วิดีโอลักษณะนี้ทำคล้ายกับ ‘ละครน้ำเน่า’ โดยนำเสนอความสัมพันธ์สามเส้าระหว่างฮุนเซน บุนรานี และมาลี ผ่านการจัดฉากให้ดูเหมือนภาพจากกล้องวงจรปิด บทสนทนาที่แอบได้ยิน หรือตอนต่อเนื่องที่มีชื่อว่า ‘ละครไร้คุณธรรม’ ที่แสดงภาพมาลีแอบมีความสัมพันธ์กับฮุนเซนและบุนรานีจับได้ วิดีโอรูปแบบนี้จะดึง engagement ได้สูงเป็นพิเศษ เนื่องจากผสานดราม่ากับความบันเทิงเข้ากับการทำลายภาพลักษณ์ของบุคคลสาธารณะได้อย่างกลมกลืน

5. การใช้สิ่งปฏิกูล วิดีโอกลุ่มนี้เปลี่ยนเป้าหมายจากโจมตีผู้นำมาสู่ประชาชนชาวกัมพูชา โดยใช้รถดูดส้วมเป็นเครื่องมือหลักในการโจมตี ตัวอย่างเช่น วิดีโอนักข่าวถามคนขับรถดูดสวมว่า “ขึ้นมาบนรถดูดสวมแบบนี้จะเอารถมาทำอะไรคะ” คนขับตอบว่า “ถ้าคุยกันดีๆ ไม่รู้เรื่อง ก็ต้องคุยกับขี้แล้วกัน” หรือวิดีโอที่ให้ชาวกัมพูชาตะโกนว่า “หิวขี้ ขอกินขี้คนไทยหน่อย” ทั้งยังพูดว่า “ขี้คนไทยนี่อร่อยจริงๆ อยากกินมาตั้งนานแล้ว” นอกจากนี้ยังพบวิดีโอที่นำเสนอการฉีดน้ำดูดสวมใส่ ‘กลุ่มเด็ก’ ชาวกัมพูชาที่ยืนอยู่หลังลวดหนาม ซึ่งมียอดชมถึง 57,000 ครั้ง

เมื่อพิจารณาเป้าหมายของการโจมตีในหมวดล้อเลียน โดยนับจำนวนครั้งที่ตัวละครต่างๆ ปรากฏในวิดีโอ ไม่ว่าจะปรากฏเดี่ยวหรืออยู่ร่วมกับผู้อื่น พบว่า ฮุนเซน คือเป้าหมายอันดับหนึ่งที่ถูกโจมตีมากที่สุด พบใน 57 วิดีโอ รองลงมาคือ มาลี โฆษกกระทรวงกลาโหมประเทศกัมพูชา พบ 36 วิดีโอ ตามด้วยชาวกัมพูชาและประเทศกัมพูชา พบ 22 วิดีโอ และ ทหารกัมพูชา พบ 17 วิดีโอ นอกจากนี้ยังพบบุคคลอื่นที่ถูกดึงเข้ามาเป็นตัวละครสมทบ เช่น บุนรานี ภริยาของฮุนเซน พบ 10 วิดีโอ แพทองธาร พบ 4 วิดีโอ ทักษิณและฮุนมาเน็ต พบอย่างละ 3 วิดีโอ และนักร้องอย่างแวนด้า พบ 2 วิดีโอ

สิ่งที่น่าสังเกตจากข้อมูลชุดนี้คือ มีถึง 19 วิดีโอด้วยกันที่ฮุนเซนและมาลีปรากฏร่วมกัน โดยส่วนใหญ่จะถูกนำเสนอในฐานะคู่ที่มีความสัมพันธ์ต่อกัน เพื่อทำลายภาพลักษณ์ผ่านมุกตลกทางเพศ นอกจากนี้ ยังพบว่าการโจมตีไม่ได้จำกัดอยู่แค่ผู้นำ แต่ขยายมาสู่ชาวกัมพูชาทั่วไปอย่างชัดเจน ขณะเดียวกันก็มีการดึงตัวละครฝ่ายไทย เช่น แพทองธารและทักษิณ เข้ามาร่วมเฟรมในสถานการณ์ที่ดูตลกหรือน่าอับอาย เช่น วิดีโอเจน AI ให้แพทองธารขี่หลังฮุนเซน หรือวิดีโอที่ให้ฮุนเซนขี่หลังทักษิณวิ่งหนีตัวเงินตัวทอง เพื่อสื่อถึงความสัมพันธ์และผลประโยชน์ที่มีร่วมกัน ตามข่าวที่ปรากฏในขณะนั้น เป็นการใช้ AI เพื่อแซะการเมืองในประเทศไทยไปพร้อมๆ กับการสร้างวาทกรรมเกลียดชังต่อกัมพูชา วิดีโอล้อเลียนลักษณะนี้ทำออกมาได้ง่ายกว่าการโจมตีเชิงนโยบายหรือโจมตีความสามารถในการบริหารบ้านเมือง และยังง่ายต่อการแพร่กระจายในรูปแบบความบันเทิงอีกด้วย

อีกประเด็นที่สำคัญคือการล้อเลียน ไม่ได้เป็นเพียงรูปแบบที่พบบ่อยที่สุด แต่ยังเป็นรูปแบบที่มักถูกใช้เป็นจุดเริ่มต้นสู่เนื้อหาที่รุนแรงกว่า จากการตรวจสอบเนื้อหาในบัญชีผู้ใช้หลายราย พบว่า ส่วนใหญ่มีจุดเริ่มต้นด้วยการล้อเลียนหรือใช้มุกตลกผ่านบทพูด ก่อนค่อยๆ เพิ่มความรุนแรงของเนื้อหาขึ้น เช่น วิดีโอที่เริ่มต้นด้วยการบ่นเรื่องเสบียง แต่จบด้วยการส่ง ‘ไข่ฟองโต’ หรือระเบิดจากเครื่องบินรบมาถล่ม หรือวิดีโอพัสดุส่งด่วน ที่ล้อเลียนการส่งของแต่จบด้วยการยิงปืนใหญ่ใส่บ้านผู้นำ

นอกจากนี้มีการใช้แฮชแท็กอย่าง #คลิปตลก #คลิปเอไอ ทำหน้าที่เป็นเกราะกำบัง เปลี่ยนสถานะของ Hate Speech ให้กลายเป็นมุกขำๆ ซึ่งอาจสร้างความคุ้นชินกับความเกลียดชัง ดังที่พบในตัวอย่างคอมเมนต์ว่า “ขำๆ..ขายหัวเราะ555..ขอบคุณ AI” หรือ “ทำหนังตลกได้เลยรายได้กระจุยกระจายแน่นอน” เมื่อผู้ชมคุ้นชินกับการเห็นผู้นำอีกฝ่ายถูกกระทำให้อับอาย การเห็นภาพศพทหารหรือการโจมตีทางทหารที่รุนแรงกว่าในคลิปถัดๆ ไป จึงกลายเป็นเรื่องที่รับได้ง่ายขึ้น

วิเคราะห์วิดีโอลดทอนคุณค่าความเป็นมนุษย์ (Dehumanization): เมื่อ AI ถูกใช้ทำให้สูญสิ้นความเป็นคน

จากการเก็บข้อมูลวิดีโอที่มีเนื้อหาสร้างความเกลียดชังในช่วงความขัดแย้งไทย-กัมพูชาที่สร้างด้วย AI ทั้งหมด 212 คลิป พบรูปแบบการลดทอนคุณค่าความเป็นมนุษย์ (Dehumanization) เป็นสัดส่วน 24.06% (51 คลิป) ของเนื้อหาทั้งหมด วิดีโอในหมวดนี้มีจุดเด่นที่มีการแสดงภาพบุคคลในฐานะสัตว์หรือสิ่งสกปรก ผ่านการใช้ AI แทนใบหน้าบุคคลนั้นลงในร่างกายของสัตว์หรือฉากที่ออกแบบมาเพื่อสื่อความด้อยกว่า กระบวนการนี้แตกต่างจากหมวดการล้อเลียน (Ridicule) ตรงที่ไม่ได้มุ่งเป้าเพียงให้เกิดเสียงหัวเราะ แต่จงใจสร้างภาพแทนว่าอีกฝ่ายไม่ใช่มนุษย์

วิดีโอที่มียอดเข้าชมและยอด engagement สูงสุดในหมวด Dehumanization

- วิดีโอที่มียอดเข้าชมสูงสุด คือวิดีโอเจน AI เป็นฮุนเซนและมาลีถูกนำไปใส่แทนหน้าคางคก นอนทับกัน และมีตัวเงินตัวทองอยู่ข้างๆ มียอดเข้าชมสูงถึง 2,100,000 ครั้ง ยอด engagement รวม 5,200 ครั้ง ยอดแชร์ 480 ครั้ง และแสดงความคิดเห็น 346 ครั้ง เผยแพร่ ณ วันที่ 23 สิงหาคม 2568

- วิดีโอที่มียอด engagement สูงสุด คือวิดีโอเจน AI เป็นภาพพยาบาลเข็นผู้ป่วยในชุดทหารกัมพูชาเข้ามาที่โรงพยาบาล แต่เมื่อหมอไทยเห็นกลับตอบว่า “ไหนล่ะ เห็นมีแต่เหี้ย” และหัวเราะเยาะอย่างสนุกสนาน มียอดเข้าชม 1,600,000 ครั้ง และมียอด engagement สูงถึง 45,000 ครั้ง ยอดแชร์ 3,000 ครั้ง แสดงความคิดเห็น 1,600 ครั้ง เผยแพร่ ณ วันที่ 4 สิงหาคม 2568

เนื้อหาลักษณะนี้สะท้อนว่า AI ถูกใช้เพื่อสร้างภาพจำที่เปลี่ยนฝ่ายตรงข้ามให้กลายเป็นสิ่งที่น่ารังเกียจและไม่มีศักดิ์ศรีความเป็นมนุษย์หลงเหลืออยู่ นอกจากนี้ เมื่อวิเคราะห์เนื้อหาของวิดีโออื่นๆ ในหมวดนี้ยังพบองค์ประกอบที่ซ้ำกัน ได้แก่

1. การเปรียบเทียบเป็นสัตว์ พบการนำหน้าของบุคคลมาใส่ในสัตว์ต่างๆ กว่า 15 ชนิด ได้แก่ ตัวเงินตัวทอง, หมาขี้เรื้อน, ควาย, หมู, ชะนี, แมลงสาบ, แมลงวัน, แมงกุดจี่, เห็บหมัด, กิ้งกือ, หนอน, งู, ตุ๊กแก, อึ่งอ่าง และคางคก การเลือกสัตว์เหล่านี้ไม่ใช่เรื่องบังเอิญ แต่สัตว์ทุกชนิดที่ถูกเลือกใช้มีความหมายเชิงลบในบริบทของไทยอย่างชัดเจน ไม่ว่าจะเป็นภาพแทนของความสกปรก ต่ำต้อย โง่เขลา หรือน่ารังเกียจ ทำให้ผู้ชมสามารถรับรู้ข้อความเชิงดูถูกหรือสร้างความรู้สึกขยะแขยงในใจผู้ชมทันทีที่เห็นภาพ โดยไม่ต้องพึ่งคำบรรยายใดๆ นอกจากนี้ยังพบการใช้ AI สร้างภาพให้ผู้นำกัมพูชาและมาลีอุ้มตัวเงินตัวทองในฐานะ ‘ลูก’ บางวิดีโอมีการเพิ่มเสียงพากย์ที่ให้ตัวละครพูดบทสนทนาด่าทอกันเองว่าเป็นสัตว์ เช่น วิดีโอเจน AI เป็นหน้าฮุนเซนมีลำตัวตัวเป็นงู และหน้ามาลีมีลำตัวเป็นตัวเงินตัวทอง พร้อมบทพูดว่า “มะลิ เธอมันตัวเงินตัวทองจริงๆ สินะ” “วุ้นเส้น เธอมันงูเหลือมกินหมา เธอมันชั่วช้าสารเลว”

2. การให้อยู่ในสถานะที่ต่ำต้อย อยู่ในพื้นที่สกปรก และมีพฤติกรรมที่สุดโต่ง ตัวละครถูกกำหนดให้คุ้ยขยะ กินขยะ คลานใส่สายจูง อยู่ในท่อน้ำเสีย น้ำเน่า อยู่ในโคลน ทำพฤติกรรมแบบสัตว์ เช่น คาบฟันปลอม คาบแพมเพิสที่เปื้อนอุจาระ การสร้างภาพตัวละครเช่นนี้เป็นระดับความรุนแรงเชิงสัญลักษณ์ที่สูงกว่าการล้อเลียนทั่วไป เพราะจะมุ่งไปที่การทำลายสุขอนามัยและศักดิ์ศรีความเป็นมนุษย์ การสูญเสียสิ่งเหล่านี้ไปทำให้ตัวละครถูกมองเป็นเพียง ‘สิ่งสกปรก’ ในสายตาผู้ชม

เมื่อพิจารณาเป้าหมายของการโจมตีในหมวด Dehumanization โดยนับจำนวนครั้งที่ตัวละครต่างๆ ปรากฏในวิดีโอ ไม่ว่าจะปรากฏเดี่ยวหรืออยู่ร่วมกับผู้อื่น พบว่า ฮุนเซน คือเป้าหมายอันดับหนึ่งที่ถูกโจมตีมากที่สุด พบใน 44 วิดีโอ รองลงมาคือ มาลี โฆษกกระทรวงกลาโหมประเทศกัมพูชา พบ 37 วิดีโอ ฮุนมาเนต บุตรชายคนโตของฮุนเซน พบ 4 วิดีโอ ชาวกัมพูชา ทหารกัมพูชา และบุนรานี ภริยาของฮุนเซน พบในสัดส่วนที่เท่ากัน อย่างละ 3 วิดีโอ

วิดีโอที่จัดอยู่ในหมวด Dehumanization นี้คือจุดที่เนื้อหาข้ามเส้นจากการล้อเลียนไปสู่รากฐานของการความรุนแรง การให้ภาพคนว่าเป็นเหี้ยหรือหมาขี้เรื้อนซ้ำหลายสิบครั้งในช่วงเวลาไม่กี่เดือนไม่ใช่การล้อเลียนธรรมดา แต่คือการก่อสร้างทางวัฒนธรรมที่ค่อยๆ ทำให้การมองอีกฝ่ายว่าเป็นสิ่งที่ต่ำกว่ามนุษย์กลายเป็นเรื่องปกติ และเมื่อนำมาพิจารณาร่วมกับข้อสังเกตว่าวิดีโอเหล่านี้ผลิตโดยบุคคลที่มีแรงจูงใจทางการหารายได้จากยอด engagement ความน่ากังวลจึงไม่ได้อยู่ที่เจตนาของผู้สร้าง แต่อยู่ที่ความรวดเร็วของเนื้อหาที่กระจายตัวไปแล้วอย่างกว้างขวาง และไม่มีกลไกใดที่จะเรียกคืนได้

วิเคราะห์วิดีโอหมวดการสร้างความเหนือกว่าทางชาตินิยมและความรุนแรง: เมื่อความรุนแรงถูกทำให้ชอบธรรมในนามความเป็นชาติ

จากการเก็บข้อมูลวิดีโอที่มีเนื้อหาสร้างความเกลียดชังในช่วงความขัดแย้งไทย-กัมพูชาที่สร้างด้วย AI ทั้งหมด 212 คลิป พบวิดีโอที่มีรูปแบบเนื้อหาสร้างความเหนือกว่าทางชาตินิยม (National Superiority) และการใช้ความรุนแรง (Violence) เป็นสัดส่วน 23.58% (50 คลิป) ของเนื้อหาทั้งหมด โดยวิดีโอในหมวดนี้จะครอบคลุมรูปแบบเนื้อหาสองกลุ่มที่มีจุดร่วมเชิงอุดมการณ์ คือ กลุ่มแรกสร้างภาพว่าไทยเหนือกว่ากัมพูชาในมิติทางการทหาร เทคโนโลยี อธิปไตย และศีลธรรม กลุ่มที่สองนำเสนอหรือสนับสนุนการใช้ความรุนแรงต่อฝ่ายกัมพูชา ทั้งสองกลุ่มถูกนำมาวิเคราะห์ร่วมในหมวดเดียวกันเพราะมักปรากฏซ้อนทับในคลิปเดียวกัน และสร้างเรื่องเล่าเดียวกันคือ ‘ฝ่ายเราชนะ ฝ่ายนั้นสมควรถูกลงโทษ’

วิดีโอที่มียอดเข้าชมและยอด engagement สูงสุดในหมวดการสร้างความเหนือกว่าทางชาตินิยมและความรุนแรง

- วิดีโอที่มียอดเข้าชมสูงสุด คือวิดีโอเจน AI เป็นศพทหารกัมพูชานอนเกลื่อน ระบุข้อความในคลิปว่า “ไม่มีใครพาออกไปหน่อยหรอ ญาติพี่น้องเขารออยู่นะ” มียอดเข้าชมสูงถึง 9,200,000 ครั้ง ยอด engagement รวม 31,000 ครั้ง ยอดแชร์ 9,600 ครั้ง และแสดงความคิดเห็น 2,900 ครั้ง เผยแพร่ ณ วันที่ 5 สิงหาคม 2568

- วิดีโอที่มียอด engagement สูงสุด คือวิดีโอเจน AI เป็นภาพซากปรักหักพังของบ้านเรือน ระบุข้อความในคลิปว่า “หลังจากท่านแม่ทัพ สั่งให้รื้อบ้านเรือนตรงช่องอานม้ากว่า 80 หลังคาเรือน ก็ได้เอารถเครื่องจักรหนักเข้าทำลายพื้นที่ทันที” มียอดเข้าชม 2,600,000 ครั้ง และมียอด engagement สูงถึง 100,000 ครั้ง ยอดแชร์ 2,400 ครั้ง แสดงความคิดเห็น 5,400 ครั้ง เผยแพร่ ณ วันที่ 19 สิงหาคม 2568

วิดีโอภาพศพทหารกัมพูชาที่มียอดเข้าชมสูงสุดถึง 9.2 ล้านครั้ง แม้ภาพที่ปรากฏจะแสดงถึงความตายที่น่าสยดสยองของทหารกัมพูชา แต่กลับเลือกใช้คำแสดงความเป็นห่วงอย่าง “ญาติพี่น้องเขารออยู่นะ” การนำเสนอเนื้อหาผ่านวิธีนี้ทำหน้าที่เป็นเหมือน ‘โล่ทางศีลธรรม’ (Moral Shield) ให้แก่ผู้ชม เพราะรูปแบบการสื่อสารไม่ได้ถูกจัดวางให้เป็นการฉลองชัยชนะบนซากศพ แต่เป็นการตั้งคำถามด้วยความเวทนา ทำให้ผู้ชมสามารถรับชมเนื้อหาได้โดยไม่รู้สึกว่าตนเองกำลังทำผิดอะไร

อย่างไรก็ตาม การสร้างเนื้อหาลักษณะนี้ไม่ได้ทำให้ความรุนแรงลดลง และที่น่าสังเกตคือ วิดีโอกลุ่มนี้มีเนื้อหาที่บริโภคและเผยแพร่ง่ายขึ้น ผู้ชมสามารถมีปฏิสัมพันธ์ เช่น การกดไลก์หรือแชร์ โดยไม่รู้สึกว่าตนเองมีส่วนร่วมสร้างความรุนแรง ตลอดจนทำให้ความรุนแรงกลายเป็นเรื่องปกติ จึงจะเห็นได้ว่า วิดีโอในหมวดนี้มียอดการแชร์ที่สูงมาก และสูงที่สุดเมื่อเทียบกับวิดีโอในทุกหมวด

นอกจากนี้ เมื่อพิจารณาวิดีโออื่นในชุดข้อมูลเดียวกัน ยังพบรูปแบบการผลิตเนื้อหาที่เป็นแบบแผน โดยในช่วงวันที่ 2-10 สิงหาคม 2568 มีวิดีโออย่างน้อย 12 คลิปจากบัญชีผู้สร้างเดียวกันที่ใช้โครงสร้างเหมือนกันทั้งหมด คือภาพศพทหารกัมพูชาอยู่ในสถานที่ต่างๆ เช่น แม่น้ำ ทุ่งหญ้า ป่า หรือปราสาท แต่เปลี่ยนข้อความกำกับในคลิปเล็กน้อย เช่น “เริ่มจะใกล้เน่าไปทุกที” “ป่านนี้เข้ามาเก็บกันหรือยังนะ” หรือ “แมลงวันเริ่มตอมแล้ว” สะท้อนว่าวิดีโอเหล่านี้ไม่ได้เป็นการผลิตเนื้อหาแบบธรรมชาติ แต่เป็นการทดลองโดยใช้ภาพชุดเดิมแล้วปรับข้อความเพื่อดูว่ารูปแบบใดสร้าง engagement ได้ดีที่สุด และผลคือคลิปที่ใช้ประโยค “ญาติพี่น้องเขารออยู่นะ” ทำผลงานได้ดีที่สุด ด้วยยอดเข้าชม 9.2 ล้านครั้ง ซึ่งมากกว่าคลิปอื่นในกลุ่มเดียวกันราว 5-10 เท่า แสดงให้เห็นว่า โทนความเวทนา ไม่เพียงทำหน้าที่เป็นโล่ทางศีลธรรม แต่ยังเป็นสูตรที่มีประสิทธิภาพในการดึงความสนใจและการมีส่วนร่วมของผู้ชมอย่างมีนัยสำคัญ

ส่วนวิดีโอที่มียอด engagement สูงสุด ซึ่งแสดงภาพซากบ้านเรือนที่ถูกทำลาย แม้ยอดวิวจะต่ำกว่าวิดีโอภาพศพ ราว 3.5 เท่า แต่กลับมี engagement สูงกว่ามาก โดยเฉพาะจำนวนคอมเมนต์ที่เพิ่มขึ้นเกือบ 2 เท่า ทำให้คลิปนี้มีอัตราการมีส่วนร่วมสูงที่สุดในวิดีโอทั้งหมด นอกจากนี้ การอ้างถึง ‘ท่านแม่ทัพ’ ยังช่วยเพิ่มความน่าเชื่อถือให้กับเนื้อหา โดยทำให้การกระทำนั้นดูเป็นคำสั่งอย่างเป็นทางการของรัฐ แม้ภายหลังภาครัฐจะมีการออกมายืนยันว่าเป็นข่าวปลอม แต่วิดีโอนี้ก็ถูกแชร์ไปอย่างกว้างขวาง สะท้อนข้อจำกัดของระบบตรวจจับเนื้อหา ขณะเดียวกัน ช่องว่างระหว่างยอดวิวกับ engagement ยังบ่งชี้ว่า ผู้ชมไม่ได้เพียงถูกอัลกอริทึมพามาดู แต่มีสัดส่วนสูงที่เลือกจะมีส่วนร่วมกับวิดีโอนี้ โดยความเห็นที่ได้รับการกดถูกใจกว่า 1 พันครั้ง ระบุว่า “ท่านแม่ทัพทำถูกแล้ว” “ต้องเด็ดขาดงี้ สุดยอด ท่านแม่ทัพ” โดยตัวเลข engagement 100,000 ครั้งนี้ หมายความว่ามีผู้ชมกว่า 100,000 รายที่รู้สึกถูกกระตุ้นให้อยากมีส่วนร่วมกับเนื้อหานี้ และอาจมีแนวโม้มในการส่งต่อความเกลียดชังมากกว่าคลิปที่มีคนดู 9.2 ล้านรายแต่เป็นการดูผ่านไปเฉยๆ

เมื่อวิเคราะห์เนื้อหาของวิดีโออื่นๆ ในหมวดนี้ยังพบองค์ประกอบที่ซ้ำกัน ได้แก่

1. ให้ภาพแสนยานุภาพทางทหารของไทยที่เหนือกว่า มีการใช้ภาพ AI เจนภาพเครื่องบินรบ F-16, จรวดกริพเพน, รถถัง และเรือดำน้ำในการถล่มฐานทัพหรือบ้านพักของผู้นำกัมพูชา

2. การทำให้ความตายเป็นเรื่องปกติ มีการใช้ภาพศพทหาร เลือด และแมลงวันที่ตอมศพ เพื่อสื่อว่าฝ่ายตรงข้ามถูกกำจัดไปเป็นจำนวนมาก

3. วาทกรรม ‘เพื่อชาติ’ และการปกป้องอธิปไตย มักใช้ประโยคอย่าง “ดอกนี้เพื่อคนไทยทั้งประเทศ” “ของขวัญจากไทย” หรือ “พัสดุส่งด่วน” ร่วมกับการโจมตีด้วยการทิ้งระเบิด มีการสร้างภาพการกั้นกำแพงและลวดหนามสูงเพื่อตัดความสัมพันธ์ระหว่างประเทศ พร้อมตั้งคำถามกับผู้ชมว่า “เพื่อนๆ คิดว่าไง” เพื่อเปลี่ยนผู้ชมให้กลายเป็นผู้มีส่วนร่วมในการตัดสินใจนั้น

เมื่อพิจารณาเป้าหมายของการโจมตีในหมวดการสร้างความเหนือกว่าทางชาตินิยมและความรุนแรง โดยนับจำนวนครั้งที่ตัวละครต่างๆ ปรากฏในวิดีโอ ไม่ว่าจะปรากฏเดี่ยวหรืออยู่ร่วมกับผู้อื่น พบว่า ทหารกัมพูชา คือเป้าหมายอันดับหนึ่งที่ถูกโจมตีมากที่สุด พบใน 26 วิดีโอ รองลงมาคือโจมตีไปที่ชาวกัมพูชาและประเทศกัมพูชาในภาพรวม พบ 20 วิดีโอ และโจมตี ฮุนเซน โดยตรง พบ 4 วิดีโอ ซึ่งจะเน้นการถล่มบ้านพักด้วยระเบิด

จากตัวเลขนี้จะเห็นว่าเป้าหมายในการโจมตีนั้นแตกต่างจากหมวดล้อเลียน หรือลดทอนความเป็นมนุษย์อย่างชัดเจน เนื่องจากจุดประสงค์หลักของการสร้างของวิดีโอในหมวดนี้เพื่อต้องการเห็นฝ่ายตรงข้ามพ่ายแพ้ เป้าหมายจึงเปลี่ยนจากผู้นำมาเป็นการโจมตีทหารและประเทศในภาพรวม เพื่อตอกย้ำชัยชนะและความเหนือกว่าของชาติตนเอง รูปแบบนี้จึงนับว่ามีอันตรายกว่าการโจมตีไปที่ตัวบุคคลใดคนหนึ่ง เพราะไม่มีเส้นแบ่งว่าชาวกัมพูชาคนไหนบ้างที่อยู่นอกขอบเขตของความเกลียดชัง

นอกจากนี้วิดีโอในหมวดนี้เลือกใช้ภาพที่มีความสมจริงสูง เช่น ภาพศพ อาวุธจริง แทนที่จะเป็นภาพสัตว์หรือการล้อเลียนแบบสุดโต่ง ซึ่งอาจทำให้ผู้รับสารจำนวนหนึ่งไม่แน่ใจว่าเนื้อหาเป็นของจริงหรือ AI สร้าง ดังที่ปรากฏในตัวอย่างคอมเมนต์ว่า “จริงหรือไม่จริงดูไม่รู้ แต่ฉันชอบนะ” “ของจริงหรือของปลอม ปลอมอย่าเอามาลงเลยค่ะ” “เรื่องจริงรึเปล่าเนี่ย ถ้าจริงก็ยอดเยี่ยมมากเลย” โดยงานวิจัยด้านเทคโนโลยีดีพเฟค (Deepfake) ซึ่งเป็นเทคโนโลยีการปลอมแปลงใบหน้าและเสียงที่สมจริง ของ Chesney & Citron (2019) ชี้ให้เห็นว่าอันตรายที่ร้ายแรงที่สุดของ Deepfake ไม่ใช่เพียงแค่การทำให้คนหลงเชื่อในข้อมูลเท็จ แต่คือการทำลายความสามารถของสังคมในการแยกแยะความจริงออกจากความเท็จ ซึ่งเป็นสิ่งที่วิดีโอในหมวดนี้ทำได้อย่างมีประสิทธิภาพ

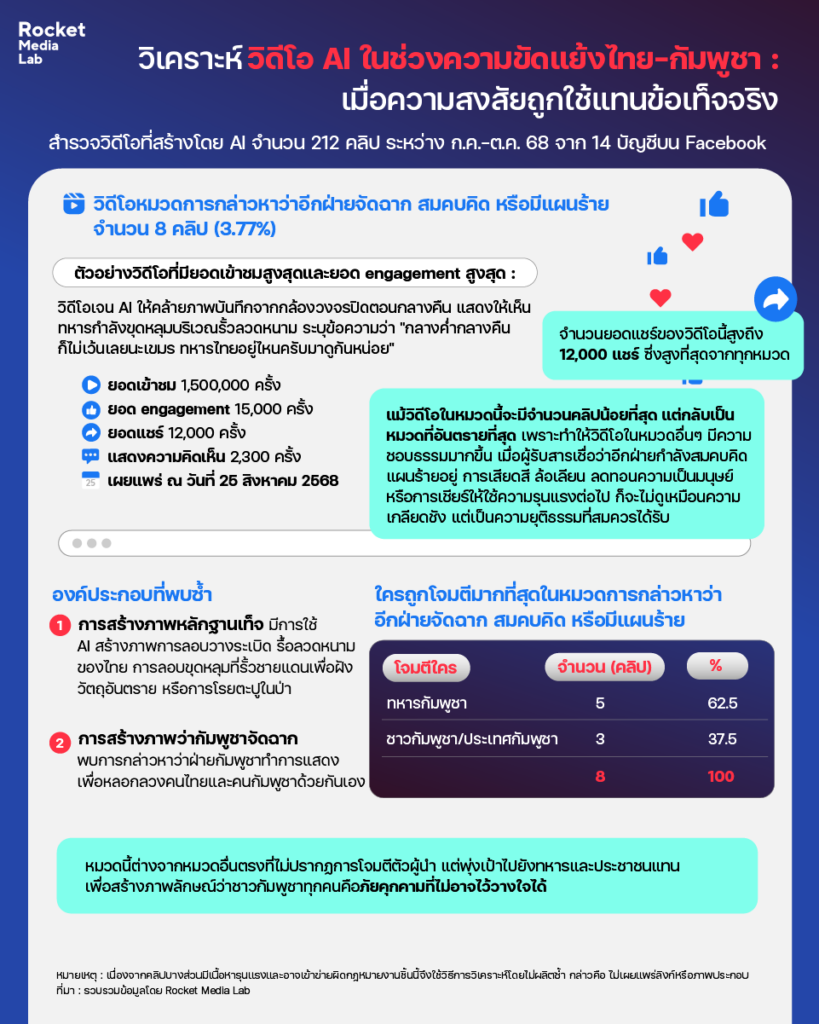

วิเคราะห์วิดีโอหมวดการกล่าวหาว่าอีกฝ่ายจัดฉาก สมคบคิด หรือมีแผนร้าย: เมื่อความสงสัยถูกใช้แทนข้อเท็จจริง

จากการเก็บข้อมูลวิดีโอที่มีเนื้อหาสร้างความเกลียดชังในช่วงความขัดแย้งไทย-กัมพูชาที่สร้างด้วย AI ทั้งหมด 212 คลิป พบวิดีโอที่มีรูปแบบเนื้อหากล่าวหาว่าอีกฝ่ายมีแผนร้าย สมคบคิด หรือจัดฉากหลอกลวง (Conspiracy) พบเป็นสัดส่วน 3.77% (8 คลิป) ของเนื้อหาทั้งหมด โดยวิดีโอในหมวดนี้มีลักษณะกล่าวหาว่าฝ่ายกัมพูชากำลังวางแผนหรือดำเนินการลับบางอย่าง ไม่ว่าจะเป็นการรื้อรั้วลวดหนาม ขุดหลุมใกล้แนวชายแดน ลักลอบเข้าประเทศ หรือปกปิดยอดผู้เสียชีวิตจากสาธารณะ เนื้อหาในหมวดนี้แม้จะพบเป็นสัดส่วนน้อยที่สุด แต่กลับมีอิทธิพลสูงในการปลุกปั่นกระแสความระแวงของผู้คนภายในประเทศ

วิดีโอที่มียอดเข้าชมและยอด engagement สูงสุดในหมวดการกล่าวหาว่าอีกฝ่ายจัดฉาก สมคบคิด หรือมีแผนร้าย

- วิดีโอที่มียอดเข้าชมสูงสุดและยอด engagement สูงสุด คือวิดีโอเจน AI ให้คล้ายภาพบันทึกจากกล้องวงจรปิดตอนกลางคืน แสดงให้เห็นทหารกำลังขุดหลุมบริเวณรั้วลวดหนาม ระบุข้อความว่า “กลางค่ำกลางคืนก็ไม่เว้นเลยนะเขมร ทหารไทยอยู่ไหนครับมาดูกันหน่อย” มียอดเข้าชมสูงถึง 1,500,000 ครั้ง ยอด engagement รวม 15,000 ครั้ง ยอดแชร์ 12,000 ครั้ง และแสดงความคิดเห็น 2,300 ครั้ง เผยแพร่ ณ วันที่ 25 สิงหาคม 2568

สิ่งที่ทำให้วิดีโอนี้ได้รับความสนใจคือรูปแบบการนำเสนอที่เลือกใช้ภาพจากกล้องวงจรปิด เพื่อสร้างภาพว่านี่คือ ‘หลักฐานจริง’ ที่ถูกจับได้ วิธีนี้ช่วยลดการคัดกรองข้อมูล (Critical Thinking) ของผู้ชม และทำให้สิ่งที่ AI สร้างขึ้นดูเหมือนหลักฐานชิ้นสำคัญที่ถูกเปิดโปง มากกว่าจะเป็นเพียงคอนเทนต์เพื่อความบันเทิง

สิ่งที่สะท้อนชัดเจนว่าผู้ชมเชื่อและตื่นตระหนกกับหลักฐานปลอมที่ AI สร้างขึ้นคือจำนวนยอดแชร์ของวิดีโอนี้ที่สูงถึง 12,000 แชร์ ซึ่งสูงที่สุดจากทุกหมวด ทั้งยังพบการแสดงความคิดเห็นที่แฝงด้วยความกังวลต่อความปลอดภัยในพื้นที่ชายแดน เช่น “ทหารไทยอยู่ไหนนะ มันกำลังฝังลูกระเบิดหรือเปล่าตรงไหนก็ไม่รู้เลยนะคะ” “สันดานโจรชัดๆ บ้านหนองจานก็ระวังนะคะแกล้งป่วนส่วนอีกทางอาจจะวางทุ่นก็ได้ คำสั่งมันอาจจะมาแบบนี้ พวกนี้เชื้อไม่ทิ้งแถว” หรือ “เห็นเขาขนาดนี้ยังทำอะไรเขาไม่ได้เลยเหรอ” แสดงให้เห็นว่า AI ถูกใช้เพื่อเปลี่ยนจากความเกลียดชังเชิงตัวบุคคล เช่น ฮุนเซน หรือ มาลี ไปสู่การสร้างภาพจำว่าประชาชนและทหารกัมพูชาทุกคนคือภัยคุกคามที่พร้อมจะทำร้ายคนไทยทุกเมื่อ

นอกจากนี้ยังพบว่าบัญชีผู้โพสต์คลิปนี้มาตอบกลับบางความเห็นด้วย เช่น เมื่อมีผู้ชมแสดงความเห็นว่า “ถ่ายให้จบหน่อยว่าขุดอะไร” ผู้โพสต์ก็มาตอบกลับว่า “มันหนีไปก่อนคับ” ทำให้การสร้างกระแสความหวาดระแวงไม่ได้จบเพียงแค่การลงคลิป แต่มีการสร้างปฏิสัมพันธ์กับผู้ชมต่อ ซึ่งอาจทำให้ผู้ชมเชื่อว่าเหตุการณ์นี้เกิดขึ้นจริง

แม้หมวดนี้จะมีเพียง 8 คลิป แต่พบองค์ประกอบที่ซ้ำกันชัดเจน แบ่งได้เป็น 2 รูปแบบ คือ

1. การสร้างภาพหลักฐานเท็จ มีการใช้ AI สร้างภาพการลอบวางระเบิด รื้อลวดหนามของไทย การลอบขุดหลุมที่รั้วชายแดนเพื่อฝังวัตถุอันตราย หรือการโรยตะปูในป่า

2. การสร้างภาพว่ากัมพูชาจัดฉาก พบการกล่าวหาว่าฝ่ายกัมพูชาทำการแสดงเพื่อหลอกลวงคนไทยและคนกัมพูชาด้วยกันเอง เช่น วิดีโอเจน AI เป็นทหารสั่งให้ชาวบ้านทำหน้าเศร้า ร้องไห้ เพื่อหลอกให้ไทยเปิดด่าน หรือวิดีโอกล่าวหาว่ากองทัพกัมพูชาโกหกเรื่องยอดการสูญเสีย โดยสร้างภาพ AI เป็นทหารกัมพูชา ใส่บทสนทนาว่า “ทหารของเราสูญเสียไป 2 พันนายแล้ว” “รายงานประชาชนว่าแค่ 20 คนพอ” เพื่อชูให้ฝ่ายไทยเป็นผู้กุมความจริงที่เหนือกว่า

นอกจากนี้คำบรรยาย (Caption) ในแต่ละวิดีโอของหมวดนี้ มักใช้การตั้งคำถามเพื่อทำให้ผู้ชมมีอารมณ์ร่วมไปด้วย เช่น “เขมรเหิมเกริมรื้อลวดหนามไทย ทำยังไงดีครับเพื่อนๆ” หรือ “ใช่มันป่าววะ เพื่อนๆ ช่วยดูหน่อย” “เขมรจงจำไว้ ความเจ็บครั้งนี้ มึงจะต้องได้รับคืนอย่างสาสม” วิธีนี้ทำให้ผู้ชมรู้สึกว่าตนเองมีส่วนร่วมในการป้องกันประเทศ การสร้างภาพจำว่าทุกคนที่อยู่ฝ่ายตรงข้ามคือภัยคุกคามของวิดีโอหมวดนี้ ทำให้เกิดความรู้สึกชอบธรรมหากจะตอบโต้ด้วยความรุนแรงในท้ายที่สุด

เมื่อพิจารณาเป้าหมายของการโจมตีในหมวดการกล่าวหาว่าอีกฝ่ายมีแผนร้าย สมคบคิด หรือจัดฉากหลอกลวง โดยนับจำนวนครั้งที่ตัวละครต่างๆ ปรากฏในวิดีโอ ไม่ว่าจะปรากฏเดี่ยวหรืออยู่ร่วมกับผู้อื่น พบว่า ทหารกัมพูชา คือเป้าหมายอันดับหนึ่งที่ถูกโจมตีมากที่สุด พบใน 5 วิดีโอ อยู่ในฐานะผู้ปฏิบัติตามแผนลับ รองลงมาคือโจมตีไปที่ชาวกัมพูชา พบ 3 วิดีโอ อยู่ในฐานะผู้ร่วมขบวนการลักลอบเข้าเมืองหรือจัดฉากหลอกลวง

จะเห็นว่าหมวดนี้ต่างจากหมวดอื่นตรงที่ไม่ปรากฏการโจมตีตัวผู้นำ แต่พุ่งเป้าไปยังทหารและประชาชนแทน เพื่อสร้างภาพลักษณ์ว่าชาวกัมพูชาทุกคนคือภัยคุกคามที่ไม่อาจไว้วางใจได้ วิดีโอที่ถูกผลิตในหมวดนี้มุ่งทำลายความน่าเชื่อถือของอีกฝ่ายในทุกมิติ ไม่ว่าความทุกข์ยากที่เกิดขึ้นจริงกับอีกฝ่ายจะเป็นอย่างไร ผู้ชมฝั่งไทยที่รับสารและเชื่อในวิดีโอหมวดนี้ก็จะมองว่าเป็นเพียงการแสดง แม้จะมีจำนวนคลิปน้อยที่สุด แต่วิดีโอในหมวดนี้กลับเป็นหมวดที่อันตรายที่สุดเพราะทำให้วิดีโอในหมวดอื่นๆ มีความชอบธรรมมากขึ้น เมื่อผู้รับสารเชื่อว่าอีกฝ่ายกำลังสมคบคิดแผนร้ายอยู่ การเสียดสี ล้อเลียน ลดทอนความเป็นมนุษย์ หรือการเชียร์ให้ใช้ความรุนแรงต่อไป ก็จะไม่ดูเหมือนความเกลียดชัง แต่เป็นความยุติธรรมที่สมควรได้รับ

วิดีโอ AI ไม่ได้ผลิตขึ้นเพื่อให้ชาวกัมพูชาได้ยิน แต่เพื่อให้คนไทยได้ดู

จากการรวบรวมวิดีโอทั้งหมด 212 วิดีโอ พบลักษณะร่วมที่สำคัญคือ ตัวละครทุกตัวล้วนเป็นวิดีโอที่ใช้พูดภาษาไทย ไม่ว่าจะเป็นเสียงของ ฮุนเซน มาลี ฮุนมาเน็ต ทหารกัมพูชา หรือแม้กระทั่งตัวละครที่ถูกนำเสนอว่าเป็นนักข่าวต่างประเทศหรือนักท่องเที่ยวต่างชาติ สิ่งนี้ไม่ได้เป็นเพียงเทคนิคในการสร้างเนื้อหา แต่เป็นข้อเท็จจริงสำคัญที่สะท้อนว่า วิดีโอเหล่านี้ไม่ได้ผลิตขึ้นเพื่อสื่อสารหรือตอบโต้กับชาวกัมพูชาโดยตรง แต่ผลิตขึ้นเพื่อสร้างพื้นที่สำหรับการเยาะเย้ยของคนไทยโดยเฉพาะ

การเลือกใช้ภาษาไทยเป็นภาษาหลักของเนื้อหา ทำให้ผู้ชมชาวไทยสามารถเข้าถึงและมีส่วนร่วมกับเนื้อหาได้ทันที ในขณะเดียวกัน การนำเสนอผู้นำและประชาชนกัมพูชาให้พูดภาษาไทย ยังเป็นวิธีหนึ่งในการวางตัวตนของอีกฝ่ายให้กลายเป็นเพียงตัวละครในเรื่องเล่าที่คนไทยเป็นผู้ควบคุม โดยตัวละครเหล่านี้มักถูกกำหนดให้พูดประโยคที่ลดทอนคุณค่าของตนเอง เช่น การยอมรับว่าเป็น ‘ขอทาน’ หรือการว่าโจมตีประเทศของตนว่า ‘จนจะตายห่า’ ไม่มีอะไรที่สู้ไทยได้ นอกจากนี้ยังมีการนำภาษาอีสานมาใช้ในบทสนทนาเพื่อเพิ่มอรรถรสและความตลกขบขัน เช่น การพากย์เสียงให้คนแก่พูดภาษาอีสานเพื่อด่าทออีกฝ่ายว่า “ซุมขี้กะตืกเขมร” หรือการใช้คำเรียกแทนฮุนเซนว่า ‘วุ้นเส้น’ ซึ่งเป็นคำที่ผู้ชมชาวไทยเข้าใจและรู้สึกมีส่วนร่วมได้ทันที

อีกสิ่งที่น่าสังเกตคือ เมื่อวิดีโอต้องการนำเสนอเสียงของต่างชาติเพื่อมายืนยันความเหนือกว่าของฝ่ายไทยเช่น ตัวละครนักข่าวต่างชาติที่ตำหนิทหารกัมพูชาว่าโกหก หรือนักท่องเที่ยวต่างชาติที่ระบุว่าเที่ยวประเทศไทยดีกว่า ตัวละครเหล่านั้นก็ยังพูดภาษาไทยอยู่ดี ถือเป็นการใช้ AI สร้างความภาคภูมิใจในระดับชาติผ่านตัวละครสมมติ การใช้ภาษาไทยที่ตลกขบขันและการติดแฮชแท็กอย่าง #คลิปตลก #ฮา #เพื่อความบันเทิง ทำให้วาทกรรมเกลียดชังเหล่านี้ดูเบาลงและแนบเนียนขึ้น และผู้ชมมักเข้ามาคอมเมนต์ในเชิงสนุกสนาน เช่น “คนไทยนี่อย่างปั่น” หรือ “ขอบคุณ AI ที่ทำให้มีอะไรขำๆ ดู” ส่งผลให้ความขัดแย้งถูกทำให้กลายเป็นเรื่องบันเทิงที่เข้าถึงง่ายสำหรับคนไทยด้วยกันเอง

สำรวจเครื่องมือสร้างวิดีโอจาก AI : เมื่อความเกลียดชังสร้างง่ายเพียงปลายนิ้ว

จากการวิเคราะห์วิดีโอที่สร้างด้วย AI ผ่านการตรวจสอบลายน้ำที่ปรากฏในคลิป และการใช้โปรแกรม HIVE เพื่อตรวจสอบย้อนหลัง พบเครื่องมือหลักที่ใช้สร้างวิดีโอจาก AI ได้แก่

- HeyGen เป็นเครื่องมือสร้างวิดีโอจากข้อความพร้อมใบหน้าคนพูดที่สมจริงได้ มีจุดเด่นที่สามารถพูดและแสดงท่าทางได้อย่างสมจริง พร้อมเปลี่ยนปากให้ตรงกับเสียง และยังสามารถใช้งานร่วมกับเครื่องมือออกแบบอย่าง Canva ได้อีกด้วย

- Google Veo3 ใช้สำหรับสร้างวิดีโอจากข้อความ โดย Veo3 สามารถสร้างเสียงบรรยากาศ เสียงดนตรีประกอบ หรือแม้แต่บทสนทนาที่ลิปซิงค์ (Lip-sync) กับปากของตัวละครในวิดีโอได้โดยตรงไม่ต้องใช้โปรแกรมอื่นช่วย และสามารถรักษาหน้าตาและลักษณะของตัวละครให้คงเดิมตลอดทั้งคลิป แม้จะมีการเปลี่ยนมุมกล้องหรือฉาก

- Hailuo AI เป็น AI สัญชาติจีนที่สามารถสร้างวิดีโอจากข้อความ สามารถทดลองใช้งานได้ฟรีแบบจำกัดเครดิต โดยรองรับทั้งการใช้งานบนเบราว์เซอร์และแอปพลิเคชันมือถือ

- Kling AI เป็น AI สัญชาติจีน รองรับการสร้างคลิปวิดีโอที่มีความยาวต่อเนื่องได้สูงสุดถึง 10 วินาที มีระบบจัดเก็บตัวละครเพื่อให้สามารถนำมาใช้ซ้ำในหลายๆ ฉากได้โดยที่หน้าตาและลักษณะไม่เปลี่ยนแปลง

เครื่องมือเหล่านี้เป็นส่วนหนึ่งของเทคโนโลยีสร้างสื่อสังเคราะห์ (synthetic media) ที่สามารถแปลงข้อความให้กลายเป็นวิดีโอได้โดยอัตโนมัติ ผู้ใช้งานเพียงพิมพ์คำสั่งสั้นๆ เช่น ฉาก ตัวละคร หรือสถานการณ์ที่ต้องการ ระบบจะประมวลผลและสร้างภาพเคลื่อนไหว เสียง หรือแม้แต่บทสนทนาออกมาโดยไม่ต้องถ่ายทำจริง การเข้ามาของ AI เหล่านี้ทำให้ช่วยขั้นตอนและลดต้นทุนการผลิตลงอย่างชัดเจนเมื่อเทียบกับในอดีตที่การจะทำวิดีโอขึ้นมาสักหนึ่งชิ้น อาจจะต้องใช้ทักษะหลายด้าน เช่น การถ่ายทำ ตัดต่อ เขียนบท หรือการใช้โปรแกรมเฉพาะทาง แต่ในปัจจุบันถูกทำให้ง่ายขึ้นเพียงปลายนิ้วเพียงโดยไม่จำเป็นต้องมีทักษะต่างๆ เหล่านี้ ใช้เพียงข้อความไม่กี่บรรทัดก็สามารถสร้างเนื้อหาได้

เมื่อเครื่องมือเหล่านี้ใช้งานได้ง่ายและมีต้นทุนต่ำ ทำให้การสร้างวิดีโอไม่ได้จำกัดอยู่ในกลุ่มผู้เชี่ยวชาญอีกต่อไป แต่กลายเป็นเครื่องมือสาธารณะที่บุคคลทั่วไปสามารถเข้าถึงได้ผ่านโทรศัพท์มือถือ การเปลี่ยนแปลงนี้ทำให้การผลิตเนื้อหาบิดเบือนหรือสร้างความเกลียดชัง สามารถเกิดขึ้นได้ในวงกว้างและรวดเร็วขึ้นอย่างมีนัยสำคัญ นอกจากนี้ยังเอื้อให้เกิดการผลิตเนื้อหาในลักษณะทดลองและทำซ้ำได้อย่างรวดเร็ว โดยแค่ปรับเปลี่ยนรายละเอียดเล็กน้อย เช่น เปลี่ยนฉาก เปลี่ยนถ้อยคำ หรือปรับโทนของเนื้อหา แล้วสร้างวิดีโอหลายๆ คลิป ภายในเวลาอันสั้น ซึ่งสอดคล้องกับรูปแบบที่พบในชุดข้อมูลที่มีการผลิตคลิปจำนวนมากโดยใช้โครงสร้างคล้ายกันแต่ปรับข้อความเพื่อทดสอบการตอบสนองของผู้ชม

เครื่องมือสร้างวิดีโอด้วย AI ไม่เพียงแค่ลดขั้นตอนการผลิต แต่ได้เปลี่ยนโครงสร้างของการผลิตสื่อไปอย่างสิ้นเชิง จากเดิมที่ต้องอาศัยทักษะและทรัพยากรเฉพาะทาง กลายเป็นกระบวนการที่ขับเคลื่อนด้วยความง่ายในการเข้าถึงและความสามารถในการผลิตซ้ำ ส่งผลให้เนื้อหาเกี่ยวกับความขัดแย้งถูกสร้างและเผยแพร่ถึงความรุนแรงได้อย่างต่อเนื่อง แม้เหตุการณ์จริงจะลดระดับลงแล้วก็ตาม

แม้เครื่องมือเหล่านี้จะมีมาตรฐานความปลอดภัยในการสร้างวิดีโอจาก AI ที่เข้มงวด เช่น HeyGen ระบุว่าห้ามสร้างเนื้อหาทางการเมือง การเกลียดชัง หรือการใช้รูปลักษณ์บุคคลจริงโดยไม่ได้รับความยินยอม หรือ Google Veo ที่มีระบบคัดกรองเนื้อหา Hate Speech และความรุนแรง และมีการบล็อกการตอบกลับเนื้อหาที่เป็นอันตราย ขณะที่แพลตฟอร์มสัญชาติจีนอย่าง Kling AI และ Hailuo AI มีนโยบายเซ็นเซอร์ประเด็นละเอียดอ่อนทางการเมืองและห้ามสร้างเนื้อหาที่ก่อให้เกิดความอับอายต่อบุคคลอื่น

แต่จากฐานข้อมูลวิดีโอกลับพบช่องว่างในการบังคับใช้ที่สำคัญ กล่าวคือ ยังคงพบการผลิตเนื้อหาที่ละเมิดนโยบายเหล่านี้ออกมาได้อย่างต่อเนื่อง ไม่ว่าจะเป็นวิดีโอล้อเลียนผู้นำ หรือแม้กระทั่งวิดีโอที่แสดงภาพศพทหารซึ่งมีความรุนแรงก็ยังสามารถเข้าถึงได้อยู่ สิ่งนี้สะท้อนว่าแม้บริษัทต่างๆ จะพยายามสร้างมาตรฐานในการกำกับดูแล แต่ในทางปฏิบัติ AI ยังคงถูกนำมาใช้เป็นเครื่องมือผลิตซ้ำความเกลียดชังและบิดเบือนข้อมูลในพื้นที่ออนไลน์ได้อย่างมีประสิทธิภาพ โดยเฉพาะเมื่อถูกหล่อเลี้ยงด้วยระบบเศรษฐกิจของแพลตฟอร์มที่ให้รางวัลแก่ยอด Engagement มากกว่าคุณภาพและความถูกต้องของเนื้อหา

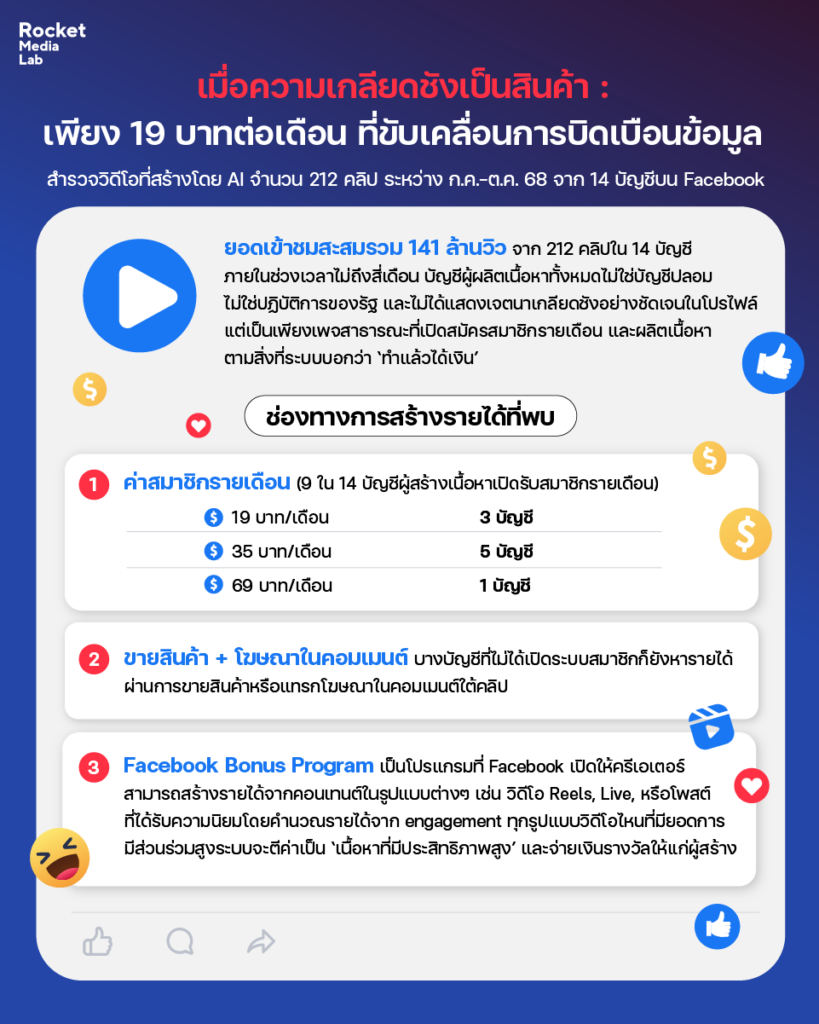

เมื่อความเกลียดชังเป็นสินค้า: เพียง 19 บาทต่อเดือนที่ขับเคลื่อนการบิดเบือนข้อมูล

จากการตรวจสอบบัญชีผู้สร้างเนื้อหาหลัก 14 บัญชี พบว่ามีถึง 9 บัญชีที่เปิดรับรายได้ผ่านการสมัครสมาชิกรายเดือน โครงสร้างนี้เปลี่ยนให้ยอดปฏิสัมพันธ์ (Engagement) ถูกแปลงเป็นรายได้โดยตรง ยิ่งเนื้อหาปั่นกระแสให้คนเข้ามาด่าทอหรือแชร์ต่อมากเท่าไหร่ โอกาสที่ผู้สร้างเนื้อหานั้นจะเปลี่ยนผู้ชมขาจรให้กลายเป็นสมาชิกรายเดือนก็ยิ่งสูงขึ้นเท่านั้น

โครงสร้างราคาสมาชิกถูกออกแบบให้อยู่ในระดับต่ำเพื่อให้ตัดสินใจสมัครได้ง่าย โดยพบช่วงราคาตั้งแต่ 19 บาท (3 บัญชี) 35 บาท (5 บัญชี) และ 69 บาทต่อเดือน (1 บัญชี) ขณะเดียวกัน บางบัญชีที่ไม่ได้เปิดระบบสมาชิกก็ยังหารายได้ผ่านการขายสินค้า หรือแทรกโฆษณาในคอมเมนต์ใต้คลิป สะท้อนให้เห็นว่าความขัดแย้งไม่ได้เป็นเพียงประเด็นทางการเมือง แต่ถูกแปรรูปเป็น ‘สินค้าความบันเทิง’ ผ่าน AI เนื้อหาจำนวนมากจึงถูกออกแบบให้มีลักษณะเป็นตอนต่อเนื่อง โดยใช้ตัวละครซ้ำ เช่น ฮุนเซนและมาลี เพื่อสร้างเรื่องราวให้ผู้ชมติดตามอย่างต่อเนื่อง ผู้ที่สมัครสมาชิกจึงไม่ได้เป็นเพียงผู้ชม แต่กลายเป็นฐานรายได้ระยะยาวที่ผู้ผลิตต้องรักษาไว้ ส่งผลให้เนื้อหาเหล่านี้ยังคงถูกผลิตซ้ำอย่างต่อเนื่อง แม้ความขัดแย้งจะลดระดับลงแล้วก็ตาม

เมื่อตรวจสอบบัญชีผู้สร้างเนื้อหาย้อนหลัง พบว่า บัญชีที่เปิดหารายได้เหล่านี้ไม่ได้เพิ่งสร้างขึ้นในช่วงความขัดแย้ง แต่มีอยู่ก่อนแล้ว โดยพบเก่าสุดตั้งแต่ปี 2553 และใหม่สุดในปี 2566 สะท้อนว่าผู้ผลิตเนื้อหาเหล่านี้มีฐานผู้ชมเดิมอยู่แล้ว เมื่อความขัดแย้งปะทุขึ้นในเดือนกรกฎาคม 2568 เหตุการณ์ดังกล่าวจึงถูกดึงเข้าสู่สายพานการผลิตคอนเทนต์อย่างรวดเร็ว คล้ายกับการปรับตัวของสื่อกระแสหลักตามกระแสข่าว แต่แตกต่างตรงที่ไม่มีระบบกลั่นกรองเนื้อหาหรือควบคุมความถูกต้องของข้อมูล

เมื่อ Engagement = รายได้โดยตรง

จากวิดีโอทั้งหมด 212 คลิป มียอดเข้าชมสะสมรวม 141 ล้านครั้ง ภายในช่วงเวลาไม่ถึงสี่เดือน บัญชีผู้ผลิตเนื้อหาทั้งหมด 14 รายนี้ไม่ใช่บัญชีปลอม ไม่ใช่ปฏิบัติการของรัฐ และไม่ได้แสดงเจตนาเกลียดชังอย่างชัดเจนในโปรไฟล์ แต่เป็นเพียงเพจสาธารณะที่เปิดสมัครสมาชิกรายเดือน และผลิตเนื้อหาตามสิ่งที่ระบบบอกว่า ‘ทำแล้วได้เงิน’

โมเดลธุรกิจของผู้ผลิตเนื้อหากลุ่มนี้เปลี่ยนความโกรธและความเกลียดชังให้เป็นรายได้อย่างเป็นระบบผ่าน Facebook Bonus Program เป็นโปรแกรมที่ Facebook เปิดให้ครีเอเตอร์สามารถสร้างรายได้จากคอนเทนต์ในรูปแบบต่างๆ เช่น วิดีโอ Reels, Live, หรือโพสต์ที่ได้รับความนิยม โดยรายได้จากโบนัสไม่ได้มาจากการดูเพียงอย่างเดียว แต่คำนวณจากการมีส่วนร่วมทุกรูปแบบ ทั้งยอดไลก์ คอมเมนต์ และการแชร์ เนื้อหาที่สร้างความขัดแย้งมักกระตุ้นให้เกิดการถกเถียงและคอมเมนต์จำนวนมหาศาล ตัวอย่างเช่น วิดีโอเจน AI ระบุในคลิปว่า “ล่าสุดชาวกัมพูชามายืนประท้วงหน้าลวดหนามของประเทศไทย บอกให้รื้อลวดหนามของประเทศไทยออก เพื่อนๆ ว่าสมควรรื้อออกไหม” วิดีโอนี้มียอดแสดงความเห็นสูงสุดถึง 11,000 ความเห็น เมื่อวิดีโอไหนที่มียอดการมีส่วนร่วมสูงเช่นนี้ระบบจะตีค่าเป็น ‘เนื้อหาที่มีประสิทธิภาพสูง’ และจ่ายเงินรางวัลให้แก่ผู้สร้างตามระดับการมีส่วนร่วมนั้น

แม้ Meta จะมีเกณฑ์ที่จะไม่นับยอดวิวจากเนื้อหาที่ผิดกฎชุมชนหรือข้อมูลเท็จ แต่จากข้อมูลพบว่าผู้สร้างส่วนใหญ่ใช้ผลิตเนื้อหาออกมาโดยใช้ความตลกเป็นเกราะกำบังไว้ และมีการติดแฮชแท็ก #เพื่อความบันเทิง #คลิปตลก #คลิปสั้นสร้างรายได้ เพื่อไม่ให้ระบบตรวจสอบมองว่าเป็น Hate Speech ส่งผลให้เนื้อหาเหล่านี้ยังไม่ถูกแบนและยังได้รับยอดการมีส่วนร่วมอย่างมหาศาล

ทั้งหมดนี้สะท้อนว่า โครงสร้างแพลตฟอร์มไม่ได้เพียงเอื้อให้การผลิตเนื้อหาเกิดขึ้นง่ายขึ้น แต่ยังสร้างแรงจูงใจโดยตรงให้ผลิตเนื้อหาที่กระตุ้นอารมณ์และดึงการมีส่วนร่วมได้สูง ซึ่งในบริบทของความขัดแย้ง ย่อมหมายถึงเนื้อหาที่มีแนวโน้มรุนแรงและสร้างความแตกแยกมากขึ้น อัลกอริทึมที่มุ่งเน้น Engagement ได้กลายเป็นเครื่องมือหลักที่ช่วยให้ครีเอเตอร์สามารถแปรรูปความเกลียดชังระหว่างประเทศให้กลายเป็นกำไรเข้ากระเป๋าตัวเองได้อย่างแนบเนียนผ่านค่าสมาชิกเพียงไม่กี่สิบบาท

ดูข้อมูลที่ https://rocketmedialab.co/database-ai-hate-speech-thailand-cambodia-conflict/

หมายเหตุ

- งานศึกษานี้เก็บข้อมูลระหว่างเดือนกรกฎาคมถึงตุลาคม 2568 โดยวิเคราะห์คลิปวิดีโอที่เกี่ยวข้องกับความขัดแย้งชายแดนไทย–กัมพูชา จาก 14 บัญชีที่โพสต์เนื้อหาดังกล่าวอย่างต่อเนื่อง รวมทั้งหมด 212 คลิป

- เนื่องจากคลิปบางส่วนมีเนื้อหารุนแรงและอาจเข้าข่ายผิดกฎหมาย งานชิ้นนี้จึงใช้วิธีการวิเคราะห์โดยไม่ผลิตซ้ำ กล่าวคือ ไม่เผยแพร่ลิงก์หรือภาพประกอบ